文章摘要:随着互联网内容形态的多元化和信息传播速度的指数级提升,内容安全问题已成为数字社会治理与平台运营中的核心议题。基于人工智能技术的内容安全监控体系,正逐步从传统的人工审核和规则匹配模式,演进为以算法驱动、模型协同和智能决策为核心的综合防控体系。本文围绕“基于人工智能技术的内容安全监控体系构建与实践探讨”这一主题,从技术背景与发展趋势、体系架构与关键技术、实践应用与运行机制以及风险挑战与优化路径四个方面展开系统论述。文章结合当前人工智能在文本、图像、音视频等多模态内容识别中的应用现状,深入分析内容安全监控体系在实际场景中的落地经验与运行成效,同时探讨其在合规性、公平性和可持续发展方面面临的问题。通过理论与实践相结合的方式,本文旨在为构建更加高效、智能和可信的内容安全监控体系提供系统性参考与实践启示。

1、技术背景与发展趋势

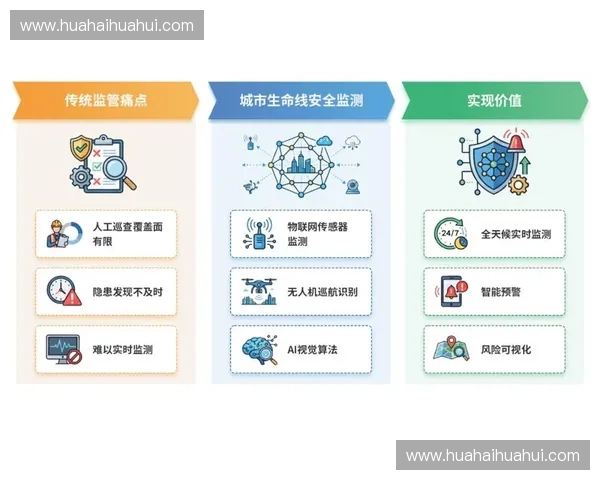

在数字化与网络化快速发展的背景下,互联网平台承载了海量用户生成内容,信息传播的门槛显著降低。这种开放性一方面激发了内容创新活力,另一方面也带来了虚假信息、不良内容和违法违规信息快速扩散的风险。传统依赖人工审核和静态规则的内容安全管理方式,已难以满足高并发、高复杂度的治理需求。

人工智能技术,尤其是机器学习与深度学习的发展,为内容安全监控提供了新的技术支撑。通过对大规模数据的学习,算法模型能够自动识别内容中的风险特征,实现对违规信息的快速筛查与精准定位。这种能力在应对信息爆炸式增长时,展现出显著的效率优势。

从发展趋势来看,内容安全监控正逐步向智能化、实时化和多模态方向演进。单一文本审核已难以覆盖复杂内容形态,图像、音频、视频等多种媒介的融合,推动人工智能模型向跨模态理解和综合判断方向发展,为体系构建提出了更高要求。

2、体系架构与关键技术

基于人工智能技术的内容安全监控体系,通常由数据采集层、智能分析层和决策执行层构成。数据采集层负责对平台内外的内容进行实时获取与预处理,为后续分析提供结构化和标准化的数据基础。

智能分析层是体系的核心,涵盖自然语言处理、计算机视觉、语音识别等关键技术。通过构建多模型协同机制,系统能够从语义、情感、场景等多个维度识别内容风险,提升识别的准确性与覆盖面。

决策执行层则负责将模型输出转化为具体的治理动作,包括内容拦截、降权、标注或人工复核等。该层强调人机协同,通过规则引擎与人工干预相结合,确保监控结果在效率与准确性之间取得平衡。

3、实践应用与运行机制

在实际应用中,人工智能内容安全监控体系已广泛部署于社交平台、内容社区和信息服务系统中。通过实时监控和批量审核相结合的方式,平台能够在内容发布初期即识别潜在风险,降低不良信息扩散概率。

运行机制上,多数平台采用“模型初筛+人工复核”的双重保障模式。人工智能模型负责处理大规模、标准化内容,而人工审核则聚焦于争议性强、语义复杂的内容,从而实现资源的合理配置。

此外,体系运行过程中还需要持续的模型训练与效果评估。通过引入用户反馈、审核结果回流等机制,不断优化模型参数和规则策略,使内容安全监控体系具备自我学习和动态演进能力。

尽管人工智能技术显著提升了内容安全治理能力,但其应用仍面临诸多挑战。其中,算法偏见和误判问题尤为突出,可能对正常内容和用户Bsport手机版表达产生不当限制,影响平台公信力。

在合规层面,不同地区对内容监管的法律法规存在差异,这对模型的统一部署和策略制定提出了更高要求。如何在技术实现中兼顾合规性与灵活性,是体系优化的重要方向。

针对上述挑战,优化路径应包括加强模型可解释性建设、完善人工干预机制以及建立多方协同治理模式。通过技术、制度与管理手段的综合运用,推动内容安全监控体系向更加透明和可信的方向发展。

总结:

总体来看,基于人工智能技术的内容安全监控体系,是应对数字时代内容治理复杂性的必然选择。其通过智能化手段显著提升了内容识别效率和风险防控能力,为平台稳定运行和网络环境净化提供了有力支撑。

未来,随着人工智能技术的持续进步和治理理念的不断完善,内容安全监控体系将更加注重人机协同、技术伦理与社会责任的统一。在不断实践与优化中,该体系有望成为数字社会内容治理的重要基础设施。